imagem: André Seiti

Originalmente com ligeira inspiração nas redes neurais de nosso próprio cérebro – particularmente nosso córtex visual –, muitos dos algoritmos de inteligência artificial de aprendizagem profunda (deep learning) em uso hoje existem há décadas, mas só recentemente estão passando por um grande aumento de popularidade. Isso é frequentemente atribuído às recentes melhorias de capacidade computacional e à grande disponibilidade de dados de treinamento. No entanto, o progresso é incontestavelmente estimulado por investimentos multibilionários dos disseminadores da vigilância em massa – empresas de tecnologia cujos modelos de negócios dependem de publicidade direcionada e psicográfica, e organizações governamentais focadas na chamada guerra ao terror. Elas coletam mais dados do que sua capacidade de saber o que fazer com eles. Precisam desesperadamente de algoritmos para processar, comprimir e compreender esses dados – compreender texto, imagens e sons – de modo que possam produzir os sumários executivos para nossas mentes humanas diminutas e pequenas. Seu objetivo é a automação da compreensão do big data. Porém, o que significa compreender? O que significa aprender ou ver?

As chamadas redes neurais profundas recebem esse nome por apresentarem muitas camadas. Cada camada é uma transformação não linear de alta dimensionalidade; aprender a extrair recursos das camadas anteriores e construir uma hierarquia de representações cada vez mais abstratas. Portanto, canalizar dados por meio de uma rede neural tão profunda é, na verdade, uma jornada por várias dimensões e transformações no espaço e no tempo. Isso é também conhecido como o problema da “inescrutabilidade da caixa-preta de redes neurais profundas”, e em meio às profundezas dessas representações está o grande desconhecido.

Uma rede neural treinada pode ter um ruído branco puramente “aleatório”1; embarcar em uma jornada passando por várias dimensões e transformações no espaço e no tempo, e produzir o que é efetivamente análogo a uma mancha de tinta de Rorschach2 – um ruído mais estruturado com uma distribuição mais particular. Quando nós olhamos para o resultado dessa rede neural, completamos o processo de criação de significado projetando-nos nele por sermos máquinas que anseiam por estrutura e projetamos significado nelas. Isso é o que fazemos. É o que sempre fizemos3. É como sobrevivemos na natureza. É como nos relacionamos uns com os outros. Olhamos para o mundo ao nosso redor, olhamos para o céu e inventamos histórias, inventamos coisas e acreditamos nelas. Buscamos regularidades e projetamos significado nelas com base em quem somos e no que sabemos.

A imagem que vemos em nossa mente consciente não é uma imagem espelhada do mundo exterior, mas uma reconstrução baseada em nossas expectativas e crenças anteriores. Tudo o que vemos, lemos ou ouvimos – até mesmo estas sentenças que estou escrevendo agora – constitui aquilo que se está tentando entender estabelecendo uma relação com suas próprias experiências passadas, filtradas por suas crenças e seus conhecimentos anteriores. Talvez se pareça mais com uma rede neural artificial do que gostaríamos de admitir.

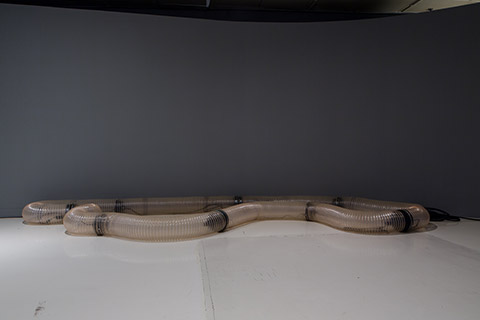

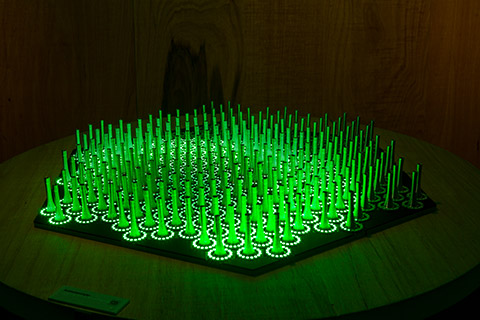

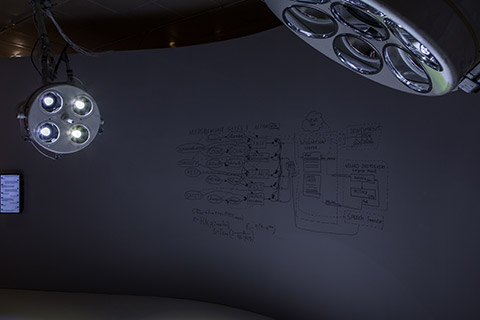

Tanto Learning to See [Aprendendo a Ver] (2017) como Deep Meditations [Meditações Profundas] (2018) são séries contínuas de trabalhos que usam algoritmos de machine learning de última geração como um meio de refletir sobre nós mesmos e sobre de que forma compreendemos o mundo. As obras fazem parte de uma linha mais ampla de pesquisa, que analisa vieses cognitivos humanos autoafirmativos, nossa incapacidade de ver o mundo do ponto de vista dos outros e a consequente polarização social.

Learning to See expõe e amplifica o viés nos sistemas de machine learning, demonstrando de que maneira o conhecimento prévio e a experiência do modelo – também conhecidos como “dados de treinamento” – moldam completamente as previsões e o resultado do modelo. Em outro nível, a obra também ilustra uma expressiva interação homem-máquina para cocriação artística – algo entre os fantoches digitais e a colaboração criativa. Uma rede neural artificial vagamente inspirada em nosso próprio córtex visual olha através das câmeras para o mundo e tenta dar sentido ao que vê no contexto do que foi visto antes. Há uma tentativa de desconstruir e reconstruir o feed da câmera ao vivo por meio de recursos e representações que a máquina aprendeu, tendo sido exposta a uma “experiência de vida” ou “visão de mundo” comparativamente limitada – neste caso específico, “treinada” em um grande conjunto de dados contendo apenas imagens de ondas, fogo, nuvens e flores. Em seguida, a obra encontra cenas desconhecidas, como mãos, tecidos, cabos e chaves. Evidentemente, ela só pode ver o que já conhece. Exatamente como nós4.

Deep Meditations é uma meditação sobre a vida, a natureza, o universo e nossa experiência subjetiva disso. Trata-se de um mergulho profundo no mundo interior de uma rede neural artificial treinada em tudo – e da exploração controlada disso. São literalmente imagens rotuladas como tudo no site de compartilhamento de fotos Flickr – assim como imagens rotuladas como mundo, universo, arte, vida, amor, fé, ritual, deus e muito mais. A intenção é apresentar, por um lado, tanto uma peça para introspecção e autorreflexão quanto um espelho para nós mesmos, nossa própria mente e como entendemos o mundo; por outro lado, também como uma janela para a mente da máquina, na medida em que tenta entender suas observações em seu próprio modo computacional. Porém, não há uma separação clara entre o espelho e a janela. É impossível separar os dois, pois o próprio ato de olhar por essa janela nos projeta através dela. Ao voltarmos nosso olhar para as imagens meditativas em lenta evolução trazidas à mente pela rede neural no limite entre o abstrato e o representativo, nós nos projetamos nelas novamente, construímos seu significado, inventamos histórias, porque vemos as coisas não como elas são, mas como nós somos5.

1 <https://commons.wikimedia.org/wiki/File:White-noise-mv255-240x180.png>

2 <https://commons.wikimedia.org/wiki/File:Rorschach_blot_01.jpg>

3 <https://commons.wikimedia.org/wiki/File:SGR_1806-20_108685main_SRB1806_20rev2.jpg>

4

<http://www.memo.tv/wpmemo/wp-content/uploads/2017/07/msa_gloomysunday_003.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2017/07/msa_gloomysunday_006.jpg>

5

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_fakes008421-16.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_fakes009402-18.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_fakes009422-22.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_fakes009884-17.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_fakes010105-16.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_fakes010115-2.jpg>

<http://www.memo.tv/wpmemo/wp-content/uploads/2018/07/deepmeditations_msa_deepmeditations_000.jpg>